- Политика

- Экономика

- Общество

- Война

- Происшествия

- Спорт

- События

- Мнения

- Криминал

- ДТП

- Новости в мире

- Новости компаний

- Таможня

- Граница

- Закон

- Налоги, штрафы

- Здравоохранение

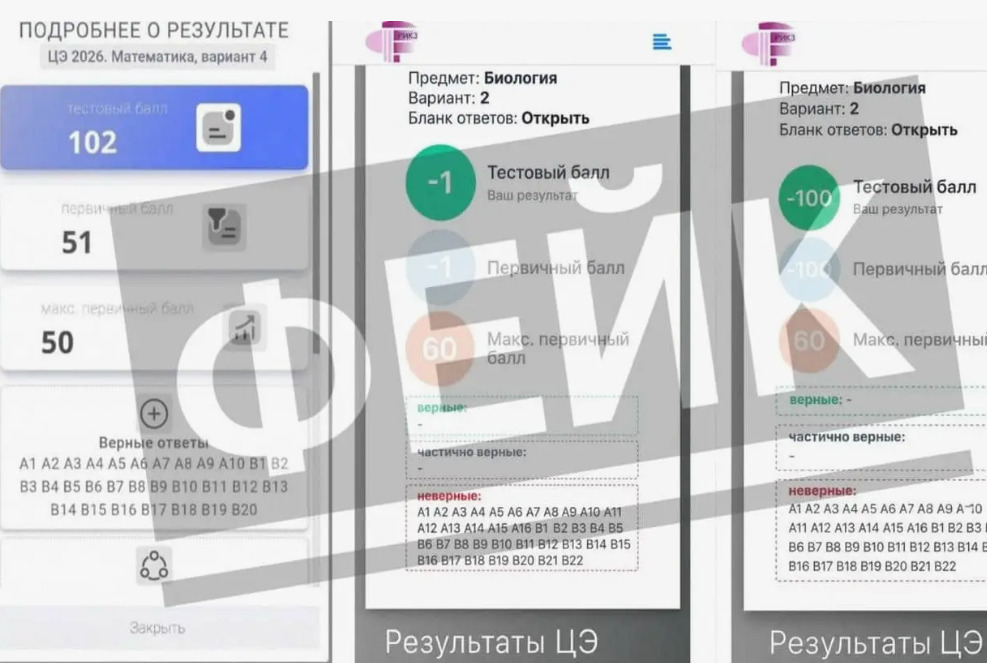

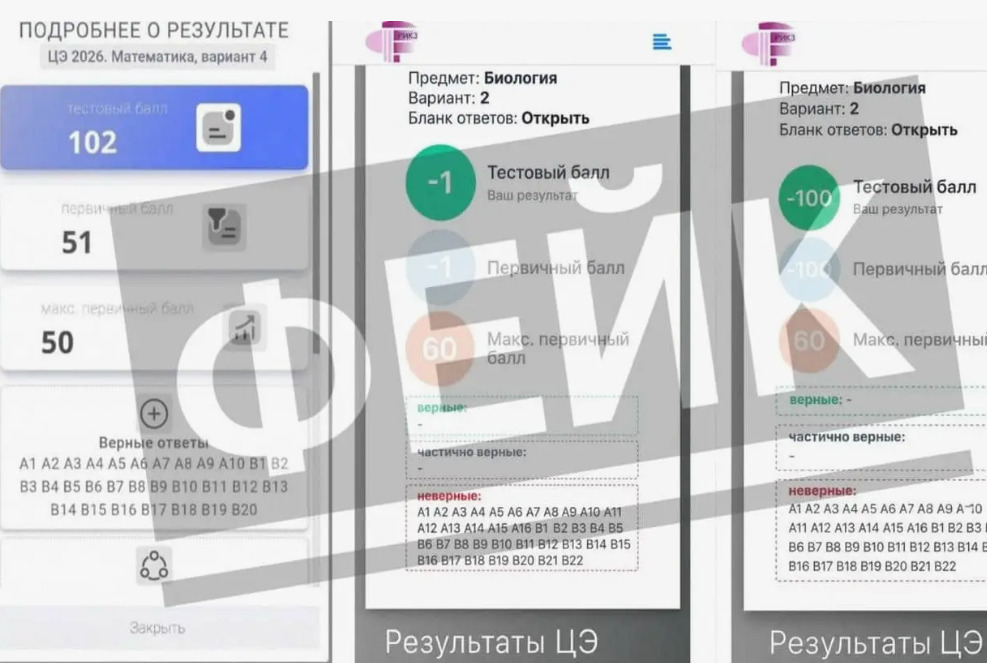

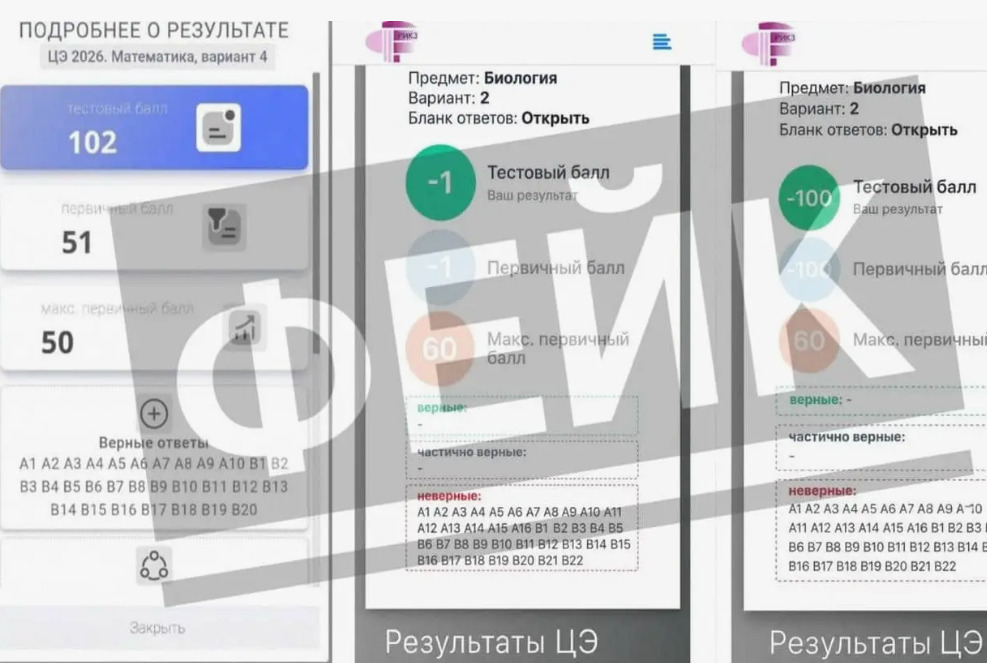

- Образование

- Культура

- Экология

- Полезные советы

- Строительство

- Технологии

- Техника

- Транспорт

- Погода

- Наука

- Люди

- Благоустройство

- Фотоотчеты

- Туризм

- Оповещения

- ЖКХ

- Обзоры

- Бизнес

- Дайджест

- Видео

- Здоровье

- Интервью

- Гороскоп

- Рецепты

- Этот день в истории

- Проза жизни

- Наши соседи

- СМИ

- Природа

- Афиша

- Новый год

- Юмор

- Жировки \

Новости

07-06-2026

07-06-2026

07-06-2026 13:51

07-06-2026 13:51

07-06-2026

07-06-2026

07-06-2026 13:37

07-06-2026 13:37

07-06-2026

07-06-2026

07-06-2026 13:03

07-06-2026 13:03

07-06-2026

07-06-2026

07-06-2026 12:43

07-06-2026 12:43

07-06-2026

07-06-2026

07-06-2026 12:21

07-06-2026 12:21

07-06-2026

07-06-2026

07-06-2026 12:00

07-06-2026 12:00

07-06-2026

07-06-2026

07-06-2026 10:14

07-06-2026 10:14

07-06-2026

07-06-2026

07-06-2026 09:15

07-06-2026 09:15

06-06-2026

06-06-2026

06-06-2026 16:33

06-06-2026 16:33

06-06-2026

06-06-2026

06-06-2026 15:40

06-06-2026 15:40

06-06-2026

06-06-2026

06-06-2026 15:08

06-06-2026 15:08

06-06-2026

06-06-2026

06-06-2026 14:27

06-06-2026 14:27